Πριν από έναν περίπου μήνα, στους προκριματικούς των Ρεπουμπλικανών στο Νιου Χάμσαϊρ των ΗΠΑ και καθώς οι ψηφοφόροι ετοιμάζονταν να μεταβούν στις κάλπες, αρκετοί έλαβαν μία ρομποτική κλήση δημιουργημένη από εργαλείο τεχνητής νοημοσύνης. Περιείχε ένα μήνυμα με την φωνή του προέδρου Τζο Μπάιντεν που καλούσε τους ψηφοφόρους να μην ψηφίσουν για να μην ενισχύσουν τον Ντόναλντ Τραμπ. Το ψεύτικο μήνυμα, που ακουγόταν ακριβώς σαν τον Μπάιντεν, είναι μία καλή απόδειξη της προόδου της τεχνολογίας deepfake, αλλά και μία τρομακτική ματιά στο πιθανό μέλλον των εκλογών ανά τον πλανήτη- ξεκινώντας από τις ευρωεκλογές, αλλά και τις αμερικανικές προεδρικές του Νοεμβρίου.

Το μήνυμα αναγνωρίστηκε ως ψεύτικο από το τμήμα Δικαιοσύνης της Πολιτείας του Νιου Χάμσαϊρ, το οποίο ειδοποίησε το κοινό για το πλαστό μήνυμα και κάλεσε τους πολίτες να μεταβούν στις κάλπες. Όπως αποδείχθηκε, η κλήση δημιουργήθηκε από την τεξανή εταιρεία Life Corporation, που χρησιμοποίησε μία «βιβλιοθήκη» deepfake που δημιουργήθηκε από την startup τεχνητής νοημοσύνης ElevenLabs. Στην Life Corporation απαγγέλθηκαν κατηγορίες για συμμετοχή σε καταστολή ψήφου.

Η μη κυβερνητική οργάνωση Brennan Center for Justice είχε ήδη προειδοποιήσει προ τριετίας, αναφερόμενη στη δεκαετία 2020-2030 πως «ξεκινούσε η εποχή του deepfake στις εκλογές», όχι μόνο στην Αμερική, αλλά σε ολόκληρο τον πλανήτη. «Ρεπουμπλικανοί υποψήφιοι των προκριματικών χρησιμοποιούν ήδη την τεχνητή νοημοσύνη σε διαφημιστικές καμπάνιες» ανέφερε το κέντρο. Επικαλούνταν μάλιστα το παράδειγμα της προεκλογικής εκστρατείας του κυβερνήτη της Φλόριντα, Ρον ΝτεΣάντις, ο οποίος δημοσίευσε φωτογραφίες δημιουργημένες με εργαλεία ΑΙ του πρώην προέδρου Ντόναλντ Τραμπ να αγκαλιάζει τον Άντονι Φάουτσι, ο οποίος «απορρόφησε» προσωπικά τη δυσαρέσκεια των Ρεπουμπλικανών ψηφοφόρων εξαιτίας των πολιτικών που συνέστησε να υιοθετηθούν στη διάρκεια της πανδημίας.

«Ένα πράγμα που παρατηρούμε είναι η διασταύρωση της τεχνολογίας της τεχνητής νοημοσύνης με τα δίκτυα «pink slime», που είναι κομματικά δίκτυα ενημέρωσης που παρουσιάζουν εαυτόν ως αξιόπιστα τοπικά ΜΜΕ και κάνουν άνοιγμα προς τους ψηφοφόρους με διαφήμιση στο Facebook», ανέφερε. Στόχος το διαφημιστικό κέρδος, το clickbait και η αλίευση δεδομένων, με ένα εργαλείο γενετικής τεχνητής νοημοσύνης που- όπως αναφέρει- αναπτύσσεται σε ευρεία κλίμακα χρησιμοποιώντας bots της γενετικής νοημοσύνης μέσω του Chat GPT της Open AI και του Bard της Google.

Propublica: Πώς να εντοπίσει κανείς (και να καταπολεμήσει) την εκλογική παραπληροφόρηση

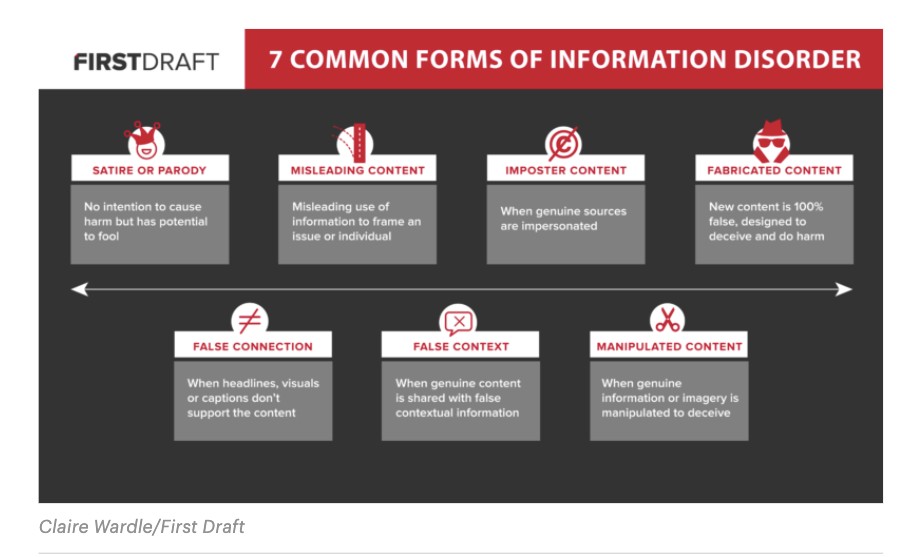

Σύμφωνα με τον εκλογικό οδηγό που είχε δημοσιεύσει το κέντρο έρευνας ProPublica στις ΗΠΑ το 2020, υπάρχουν επτά μορφές διατάραξης της πληροφόρησης σχετικά με τις εκλογές.

Κατ’ αρχήν κάνει διαχωρισμό ανάμεσα στον όρο «disinformation» και «misinformation», με τον πρώτο να αναφέρεται σε περιεχόμενο που σκόπιμα επιδιώκει να παραποιήσει την αλήθεια και να βλάψει, ενώ τον δεύτερο να αναφέρεται στην αναπαραγωγή ψευδών ειδήσεων από ανθρώπους που πιστεύουν πως είναι αληθινές. Τονίζει πως το ψεύτικο περιεχόμενο συνήθως απευθύνεται στο συναίσθημά μας και συνιστά τον διπλοέλεγχο άρθρων και εικόνων, πριν την αναδημοσίευσή τους.

Συγκεκριμένα, οι επτά πιο συνηθισμένες μορφές παραπληροφόρησης είναι οι εξής:

- Σάτιρα ή παρωδία: Πρόκειται για περιεχόμενο που δεν έχει στόχο να παραπληροφορήσει, αλλά μπορεί να εκληφθεί ως κυριολεκτικό από το κοινό, οδηγώντας σε παραπληροφόρηση

- Παραπλανητικό περιεχόμενο: Παραπλανητική χρήση πληροφοριών με σκοπό την παγίδευση ενός ατόμου ή την παρουσίαση ενός θέματος υπό ορισμένη οπτική γωνία

- Ψεύτικο περιεχόμενο: Όταν κάποιος οικειοποιείται πραγματικά πρόσωπα/πηγές

- Κατασκευασμένο περιεχόμενο: Όταν οι πληροφορίες που αναπαράγονται είναι 100% ψεύτικες, με σκοπό να παραπληροφορήσουν και να βλάψουν

- Ψεύτικες διασυνδέσεις: Όταν οι τίτλοι, η οπτική πληροφορία ή τα αποσπάσματα που παρατίθενται δεν υποστηρίζουν το περιεχόμενο αλλά είναι παραπλανητικά

- Ψευδή συμφραζόμενα: Όταν αληθινό περιεχόμενο συμπληρώνεται από συμφραζόμενα τα οποία δεν είναι αληθινά

- Κατασκευασμένα συμφραζόμενα: Όταν αληθινή πληροφορία ή εικόνα παραποιείται, με σκοπό να παραπλανήσει

Και μόνο όλες αυτές οι διαφορετικές περιπτώσεις, καταδεικνύουν πόσοι ξεχωριστοί τρόποι και αποχρώσεις υπάρχουν στις δυνατότητες παραπληροφόρησης του ευρέως κοινού, κάτι που γίνεται ιδιαίτερα εμφανές σε προεκλογικές περιόδους.

Με ποιόν τρόπο εμπλέκεται η τεχνητή νοημοσύνη στην παραγωγή τέτοιου περιεχομένου;

Όπως εξηγεί στο Mashable η Μακένζι Σαντέγκι, συντάκτρια σε θέματα τεχνητής νοημοσύνης και ξένης επιρροής στην οργάνωση παρακολούθησης της παραπληροφόρησης NewsGuard, η NewsGuard έχει εντοπίσει την χρήση τεχνητής νοημοσύνης σε όλες τις μορφές, προκειμένου να την «εργαλειοποιήσει», από την παραγωγή ολόκληρων ειδησεογραφικων ιστοσελίδων χαμηλής ποιότητας μέχρι deepfake βίντεο, ηχητικά και φωτογραφίες.

Μέχρι σήμερα, η ομάδα της NewsGuard έχει εντοπίσει 766 περιπτώσεις αναξιόπιστων ειδήσεων και 49 ενημερωτικών ιστοσελίδων δημιουργημένων μέσω τεχνητής νοημοσύνης (UAINS ή Unreliable AI-Generated News and information websites) σε 15 γλώσσες: κινέζικα, αραβικά, τουρκικά, τσέχικα, ολλανδικά, αγγλικά, γαλλικά, γερμανικά, ιταλικά, πορτογαλικά, ισπανικά, κορεατικά, ινδονησιακά, ταϊλανδέζικα και φιλιππινέζικα.

Αυτές οι ιστοσελίδες συνήθως έχουν γενικά ονόματα που παραπέμπουν σε υπαρκτές ιστοσελίδες, π.χ. iBusiness Day, Ireland Top News, Daily Time Update, τα οποία σε κάποιον αναγνώστη μπορούν να φανούν ως υπαρκτά και καθιερωμένα. Δημοσιεύουν κείμενα με ελάχιστη ανθρώπινη επίβλεψη, γραμμένα στον μεγαλύτερο βαθμό ή εντελώς από bots. Συνήθως έχουν επεξεργαστεί δεκάδες και ενίοτε εκατοντάδες άρθρα σχετικά με ένα εύρος αντικειμένων που αφορούν την πολιτική, την τεχνολογία, τη διασκέδαση και τα ταξίδια. Κάποιες φορές περιλαμβάνουν ψεύτικες πληροφορίες που αφορούν πολιτικούς ηγέτες. Ένα τέτοιο παράδειγμα ήταν η είδηση πως ο ψυχίατρος του Μπέντζαμιν Νετανιάχου αυτοκτόνησε, την οποία στη συνέχεια αναπαρήγαγαν ιρανικά σάιτ, εμφανίζοντάς το ως απόδειξη ότι ο Ισραηλινός πρωθυπουργός είναι ψυχικά ασταθής. Άλλες ψευδείς ειδήσεις αφορούν φάρσες για θανάτους διασήμων, ψεύτικα συμβάντα και άρθρα που παρουσιάζουν παλιότερες ειδήσεις με παλιότερες φωτογραφίες, σαν να έχουν συμβεί τώρα.

Σύμφωνα με την Σαντέγκι, οι 49 ιστοσελίδες που εντόπισαν το 2023, είναι πολύ πιθανό να φτάνουν πλέον τις 1000 μέχρι τη στιγμή των αμερικανικών προεδρικών εκλογών τον Νοέμβριο. Κάποιες από αυτές, παράγουν και θα παραγάγουν, εκατοντάδες τέτοια άρθρα καθημερινά!

Ποια εργαλεία υπάρχουν για να διαφυλάξει κανείς το αληθινό περιεχόμενο και να ελέγξει το πλαστό;

Μία από τις λύσεις που επεξεργάζονται ήδη οι εταιρείες τεχνητής νοημοσύνης είναι το υδατογράφημα σε γενετικά κατασκευασμένες εικόνες και βίντεο, ώστε να πιστοποιείται η τεχνολογία προέλευσης του περιεχομένου. Έτσι κάποιος μπορεί να ελέγξει το οπτικό περιεχόμενο για την προέλευσή του. Το 2023, η OpenAI, η Alphabet και η Meta, δεσμεύθηκαν να αναπτύξουν τέτοιες τεχνολογίες υδατογράφησης. Τον Οκτώβριο, η Meta παρουσίασε την Stable Signature, τη μέθοδο προσθήκης υδατογραφημάτων σε εικόνες που δημιουργήθηκαν με τη χρήση των δικών της «ανοιχτής πηγής» (open source) εργαλείων τεχνητής νοημοσύνης. Η Stable Signature δηλαδή δεν προσθέτει υδατογράφημα σε μία ήδη δημιουργημένη εικόνα, αλλά τοποθετεί αόρατα σημάδια που μπορούν να αποδοθούν σε συγκεκριμένους χρήστες των δικών της μοντέλων γενετικής ΑΙ. Τον φετινό Φεβρουάριο, η OpenAI ανακοίνωσε ότι τοποθετεί αντίστοιχα αόρατα εντοπίσιμα υδατογραφήματα σε όλες τις εικόνες που παράγονται με το πρόγραμμα DALL-E 3, ακολουθώντας τις οδηγίες της Συμμαχίας για την Προέλευση και την Αυθεντικότητα του Περιεχομένου (C2PA), ενός τεχνικού στάνταρτ που χρησιμοποιείται από την Adobe, τη Microsoft, το BBC και άλλες εταιρείες για να εντοπίζουν τα deepfakes και την παραπληροφόρηση στο δημοσιογραφικό περιεχόμενο.

Πώς να ελέγξει ένας θεατής/αναγνώστης αν το περιεχόμενο είναι ψευδές

- Στις ψεύτικες ιστοσελίδες, παρατηρείται συχνά η χρήση λογοκλοπής και «παραίσθηση» (προκειται για την τάση των εργαλείων της τεχνητής νοημοσύνης να παράγουν ψευδή γεγονότα. Η επανάληψη, η αναπαραγωγή περιεχομένου χωρίς να αποδίδονται οι πηγές, η παρουσίαση γεγονότων που αψηφούν την κοινή λογική, είναι ενδείξεις παραπληροφόρησης. Ο αναγνώστης μπορεί να ελέγξει αν το όνομα του συντάκτη είναι υπαρκτό (να αναζητήσει δηλαδή αν εμφανίζεται και σε άλλα άρθρα), αν η ιστοσελίδα εμφανίζει αξιόπιστη ταυτότητα (μπορεί επίσης να ελέγξει αν διαθέτει προφίλ στην wikipedia ή όχι) και αν επαναλαμβάνονται ασυνήθιστα λέξεις και εκφράσεις μέσα στο κείμενο.

- Η γλώσσα της τεχνητής νοημοσύνης συνήθως αποτελείται από σύντομες προτάσεις με γλώσσα χωρίς φαντασία, επισημαίνει το Better Business Bureau. Δεν χρησιμοποιούνται ιδιώματα και μεταφορές, δεν χρησιμοποιείται στον λόγο έκθλιψη, αφαίρεση και αποκοπή, χρησιμοποιούνται αντωνυμίες και απλά ρήματα. Στατιστικά στοιχεία χρησιμοποιούνται χωρίς απόδοση σε πηγές, καμιά φορά επιλέγονται περίτεχνες λέξεις, ενώ λείπει η χρήση της καθομιλουμένης.

- Οι ψεύτικες εικόνες ή ηχητικά μηνύματα πολλές φορές πιέζουν επιτακτικά τον αποδέκτη να πραγματοποιήσει κάποια ενέργεια, που μοιάζει αμφιλεγόμενη: είτε πρόκειται για την αποστολή χρημάτων σε έναν ξένο, είτε- στην περίπτωση εν προκειμένω ενός πολιτικού μηνύματος- η προσπάθεια να δημιουργήσει κανείς θυμό ή να προκαλέσει συναισθηματικές αντιδράσεις στον αποδέκτη.

Σε φωτογραφίες που παράγονται με γενετική τεχνητή νοημοσύνη, μπορεί κανείς να κάνει ζουμ και να τις ερευνήσει για λογικές ασυνέπειες, όπως περίεργη ασυμμετρία μεταξύ προσώπων και αντικειμένων ή περιγράμματα, ρούχα και αντικείμενα που δεν συνεχίζονται οπτικά στην εικόνα, περίεργη υφή στο δέρμα των ανθρώπων. Αντίστοιχα στα βίντεο μπορεί να ελέγξει για αφύσικο φωτισμό ή αδικαιολόγητες σκιές, περίεργες κινήσεις σώματος ή μάτια που δεν ανοιγοκλείνουν ποτέ. Επίσης μπορεί να χρησιμοποιήσει το πρόγραμμα About This Image της Google.

Κάποια από τα διαθέσιμα δωρεάν εργαλεία ελέγχου της τεχνητής νοημοσύνης είναι τα: Origin της GPTZero, που βοηθά στον εντοπισμό του εάν ένα κείμενο είναι γραμμένο από άνθρωπο ή υπολογιστή. Copyleaks της Chrome, που σκανάρει το γενετικά παραγόμενο ΑΙ περιεχόμενο. Deepware: Ένα σκάντερ βίντεο και φωτογραφιών για deepfake.